Wykorzystywanie sztucznej inteligencji w aplikacjach wizowych może naruszać prawa człowieka - najnowszy raport

Najnowszy raport ostrzega przed zainteresowaniem rządu federalnego wykorzystaniem sztucznej inteligencji do pracy przy przesiewaniu i przetwarzaniu profili imigrantów. Według specjalistów proces może prowadzić do dyskryminacji oraz naruszenia prywatności i praw człowieka.

Badania prowadzone przez University of Toronto's Citizen Lab opisują sposób podejmowania decyzji, automatycznie, przez aplikację imigracyjne. Naukowcy wskazują, że błędy oraz założenia w ramach technologii, mogą przynosić poważne konsekwencje, które wpłyną realnie na życie imigrantów i uchodźców.

Autorzy raportu wydali siedem zaleceń wobec działalności związanej ze sztuczną inteligencją. Badacze nawołują w nich do większej przejrzystości, publicznego raportowania oraz sprawowania nadzoru nad wykorzystywaniem nowej technologii, która ma służyć zautomatyzowaniu części prac.

“Wiemy, że rząd eksperymentuje z wykorzystaniem tych technologii ale jasne jest, że bez odpowiedniego zabezpieczeć i mechanizmów nadzoru, używanie sztucznej inteligencji w ustaleniach dotyczących imigracji i uchodźców jest bardzo ryzykowne, ponieważ wpływ na życie ludzi jest całkiem realny” - alarmuje Petra Molnar - jedna z autorek raportu

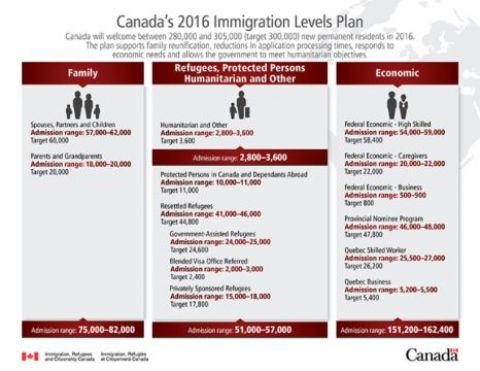

Od początku roku trwają prace urzędników federalnych nad dwoma projektami pilotażowymi, w których system sztucznej inteligencji ma sortować wnioski o wizy tymczasowe z Chin i Indii. Mathieu Genest, rzecznik ministra imigracji Ahmeda Hussena, twierdzi, że technologia ułatwia pracę funkcjonariuszy, wykonując część ich zadań przy segregowaniu wniosków wizowych online. Dodaje, że program jedynie służy jako “mechanizm sortujący”, aby ułatwić radzenie sobie z coraz to większą liczbą odwiedzających z tych krajów, a ostateczna decyzja i tak należy do urzędników imigracyjnych.

Nie jest jedyny projekt z wykorzystaniem przez Departament Imigracji sztucznej inteligencji.

W kwietniu departament zainteresował się pracą nad opracowaniem innych projektów pilotażowych z wykorzystaniem sztucznej inteligencji w niektórych obszarach prawa imigracyjnego wliczając w to humanitarne i “okolicznościowe” wnioski. Te dwa rodzaje są często stosowane przez osoby bezbronne, uciekające przed przemocą i wojną.

“Ponieważ prawo imigracyjne jest uznaniowe, grupa ta jest naprawdę ostatnią grupą, która powinna podlegać technologicznym eksperymentom bez nadzoru”- komentuje Molnar.

Rząd oznajmił, że urzędnicy są zainteresowani opracowaniem systemu, który pomoże urzędnikom Departamentu Imigracji i Sprawiedliwości zarządzać postępowaniami sądowymi i rozwijać porady prawne z zakresu prawa imigracyjnego.

“Chodzi o to, by wspierać decydentów w ich pracy, a nie ich zastępować”- powiedział Genest

Petra Molnar oświadczyła, że ma nadzieję, że urzędnicy będą liczyli się z badaniami i opiniami z Laboratorium Obywatelskiego oraz wezmą pod uwagę ich wezwanie do niezależnego organu nadzoru, który będzie zajmował się kontrolą systemów korzystających ze sztucznej inteligencji.

- Dział: Wiadomości